加入極市專業(yè)CV交流群,與6000+來自騰訊,華為,百度,北大,清華,中科院等名企名校視覺開發(fā)者互動(dòng)交流!更有機(jī)會與李開復(fù)老師等大牛群內(nèi)互動(dòng)!

同時(shí)提供每月大咖直播分享、真實(shí)項(xiàng)目需求對接、干貨資訊匯總,行業(yè)技術(shù)交流。點(diǎn)擊文末“閱讀原文”立刻申請入群~

作者:謝恩澤

來源:https://zhuanlan.zhihu.com/p/68058851

已獲作者授權(quán),請勿二次轉(zhuǎn)載

題外話

本次分享的主題是文字檢測(Text Detection),分享者是曠視研究院檢測組算法研究員謝恩澤。通過這篇文章,可以一窺曠視研究院近兩年在該方向的工作與思考,并希望為計(jì)算機(jī)視覺社區(qū)帶來啟發(fā),進(jìn)一步推動(dòng)文字檢測技術(shù)的研究與落地。

文字檢測是文字識別的第一站,曠視研究院的努力主要體現(xiàn)在緊緊圍繞文字檢測領(lǐng)域頑固而核心的問題展開,攻堅(jiān)克難,功夫花在刀刃上,比如文字形狀變化及 FP 問題等。

本文主要介紹自然場景下的文字檢測的一些定義、挑戰(zhàn)和曠視研究院檢測組的相關(guān)工作,主要包括:1)SPCNet(AAAI 2019),2)PSENet(CVPR 2019) ,3)ICDAR 2019 ArT 檢測冠軍的經(jīng)驗(yàn)分享。

導(dǎo)語

文字在人類生活中不可或缺,它代表著人類文明的發(fā)展,是人與人交流的載體。文字承載了豐富和準(zhǔn)確的高級語義信息,人們可以通過文字傳達(dá)思想和情感。

自然場景下的文字檢測是計(jì)算機(jī)視覺和目標(biāo)檢測的基礎(chǔ)研究之一,近年在深度卷積神經(jīng)網(wǎng)絡(luò)的推波助瀾下飛速進(jìn)展,其目的是給定一張圖像,定位出其中的文字區(qū)域。

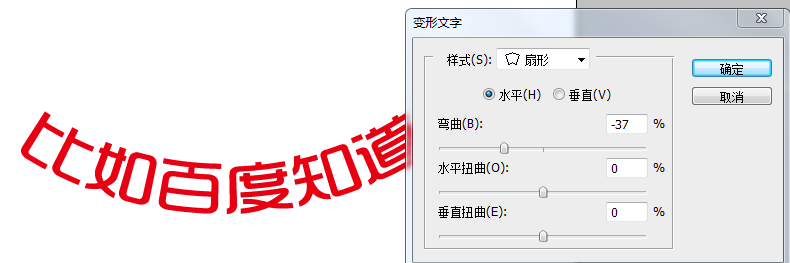

一般情況下文字檢測分為單詞和文本行兩個(gè)級別,如下圖所示:

文字檢測是很多計(jì)算機(jī)視覺任務(wù)的前置步驟,比如文字識別,身份認(rèn)證等,因此,文字的精準(zhǔn)定位既十分重要又具備挑戰(zhàn)。 相較于通用檢測,文字具有多方向、不規(guī)則形狀、極端長寬比、字體、顏色、背景多樣等特點(diǎn),因此,往往在通用物體檢測上較為成功的算法無法直接遷移到文字檢測中。

水平/多方向文字檢測

深度學(xué)習(xí)時(shí)代,傳統(tǒng)文字檢測算法被刷新,水平文字和多方向文字檢測技術(shù)獲得大發(fā)展,經(jīng)典算法有: 1)CTPN[1],2)EAST[2],3)TextBoxes[3],4)TextBoxes++[4],5) SegLink[5],6)RRPN[6] 等。

上述算法主要從通用物體檢測中汲取靈感,比如 CTPN、RRPN 基于兩步法檢測器Faster R-CNN;TextBoxes 系列和 Seglink 基于一步法檢測器 SSD;EAST 基于 Anchor Free 檢測器 DenseBox 和 UnitBox。

下面簡單介紹一下這幾個(gè)算法的優(yōu)勢和局限性:

CTPN: 通過 Faster R-CNN+LSTM 預(yù)測固定寬度的 text proposal,在后處理部分再將這些小文本段連接起來,得到文本行。只能檢測水平文本。

EAST: 繼承 DenseBox 和 UnitBox, 通過預(yù)測 shrink 的文字區(qū)域,并對區(qū)域內(nèi)的每個(gè)像素預(yù)測它到上下左右的四個(gè)距離和一個(gè)旋轉(zhuǎn)角度,Pipeline 十分簡單,同時(shí)速度較快。

TextBoxes/TextBoxes++: TextBoxes 基于 SSD 修改卷積核尺寸,更適合文字檢測,但是只能檢測水平文字。TextBoxes++ 基于 TextBoxes, 將回歸水平 box 改為回歸上下左右 4 個(gè)點(diǎn),可以檢測傾斜文字。

RRPN:基于 Faster R-CNN,通過引入 rotate anchor,實(shí)現(xiàn)多方向的文字檢測,但是引入的 anchor 成倍增加,速度較慢,計(jì)算量也較大。

這些算法在水平和多方向文字檢測數(shù)據(jù)集上不斷刷出 SOTA 成績,但是無法很好地建模彎曲文字。

在自然場景中,彎曲文字也同樣很常見,比如最經(jīng)典的星巴克 LOGO,如下圖所示。 如何科學(xué)地建模彎曲文字是一個(gè)很有挑戰(zhàn)的問題。

彎曲文字檢測的發(fā)展史要從兩個(gè)重要的數(shù)據(jù)集說起:1)Total-Text[9] 和 2)CTW-1500[10]。2017年提出兩個(gè)數(shù)據(jù)集之后,大量學(xué)術(shù)界和工業(yè)界關(guān)于彎曲文字的研究紛至沓來。曠視研究院是最早針對彎曲文字檢測展開研究并提出自身見解的機(jī)構(gòu)之一。

經(jīng)過一年多的發(fā)展,彎曲文字檢測技術(shù)形成兩條主線: 1)Top-Down 和 2)Bottom-Up方法。

將彎曲文字檢測轉(zhuǎn)化為實(shí)例分割問題,如下圖所示,通過檢測水平 box 和分割 box 內(nèi)的實(shí)例,可以很好地解決彎曲文字檢測問題。現(xiàn)有 Top-Down 方法大多基于 Mask R-CNN,比如 SPCNet[7],PMTD[11]。

將彎曲文字檢測轉(zhuǎn)化為語義分割問題,通過像素級的分類去判斷文字區(qū)域。但是由于很多情況下文本行相鄰較近,現(xiàn)有 Bottom-Up方法往往通過預(yù)測中心線定位文字實(shí)例,并通過不同方法建模完整的文字區(qū)域,比如 PSENet[8],TextSnake[12]。

由于自然場景中不少 False Positives(FP)和文字具有相似的紋理,比如圓盤、柵欄,從而很容易被誤檢為文字。曠視研究院檢測組在 AAAI2019 提出 SPCNet[7],將語義分割信息引入 Mask R-CNN,并對文字實(shí)例重新打分,從而抑制 FP 的檢測。

基于 Top-Down 方法的彎曲文字檢測雖能達(dá)到 SOTA 性能,但流程過于復(fù)雜,超參數(shù)太多,還無法實(shí)時(shí)運(yùn)行。

面對這一問題,曠視研究院檢測組和南京大學(xué)合作,在 CVPR 2019 提出 PSENet[8],通過一個(gè)簡單的語義分割框架分割出多尺度的文字,并通過漸進(jìn)式擴(kuò)展算法合并得到最終結(jié)果,在CTW1500 數(shù)據(jù)集取得 26FPS 的運(yùn)行速度。

總而言之,目前彎曲文字檢測技術(shù)主要分為自上向下(Top-Down)和自下向上(Bottom-Up)兩條路。

曠視研究院檢測組是最早發(fā)表彎曲文字檢測研究的機(jī)構(gòu)之一,并在 Top-Down 和 Bottom-Up 兩個(gè)方向分別貢獻(xiàn)了一篇論文,分別針對 FP 和實(shí)時(shí)性兩個(gè)問題。

接下來介紹的兩篇文章都是針對任意形狀文字檢測而建模的,不僅在傳統(tǒng)的水平文字/多方向文字檢測任務(wù)中效果很好,更是可以靈活地檢測彎曲和不規(guī)則的文本。

論文鏈接:https://arxiv.org/abs/1811.08605

先前解讀:https://zhuanlan.zhihu.com/p/51397423

本文以 Mask R-CNN 為 Baseline, 并在 Mask R-CNN 的基礎(chǔ)上引入 Text Context 模塊和 Re-Score 機(jī)制,從而提高檢測準(zhǔn)確率,降低 FP 的出現(xiàn)。

為什么要用 Mask R-CNN?首先,彎曲文字檢測可以轉(zhuǎn)化為一個(gè)實(shí)例分割問題,而 Mask R-CNN 是當(dāng)前最優(yōu)的實(shí)例分割框架,大多數(shù) COCO Instance Segmentation 冠軍隊(duì)伍都采用Mask R-CNN 作為 Baseline。

本文同樣采用 Mask R-CNN 取得了很高的 Baseline,通過水平 box 定位出文字區(qū)域,通過分割文字實(shí)例得到精準(zhǔn)的輪廓。

整個(gè)網(wǎng)絡(luò)流程如下圖所示,(a) 是 FPN 結(jié)構(gòu),(b) 是 text context(TCM)模塊,(c) 是Mask R-CNN 的分支,(d) 是 TCM 具體的方法。

整個(gè)方法在 Mask R-CNN 基礎(chǔ)上多一個(gè)分支做文字語義分割,并把語義分割的中間特征和檢測分支的特征融合起來,再把語義分割的預(yù)測結(jié)果作為一個(gè) mask 乘回 map,起到一個(gè)對特征 的作用。

下圖是重打分的一個(gè)可視化說明,綠色的是水平 box,紅色的是 seg 結(jié)果,下面的是全局語義分割結(jié)果,曠視研究院把 seg 結(jié)果投影到語義分割圖上,并在該區(qū)域內(nèi)算一個(gè)響應(yīng)值,得到 score,并和原來的 score 融合得到最終的 score。

為什么要引入?下圖是 re-score 模塊的可視化圖。由圖可知,Mask R-CNN 將水平box 的分類分?jǐn)?shù)最終的 score,對于傾斜文本不是很友好,并且可能會引入 FP,我們在這里將語義分割圖上的響應(yīng)和原本的 score 融合起來,得到的 fus-score 可以緩解 Mask R-CNN 直接移植到文字檢測上分類分?jǐn)?shù)不準(zhǔn)的問題。

最終, 在幾個(gè)標(biāo)準(zhǔn)數(shù)據(jù)集 、、 和 Total-Text 上都取得了 state-of-the-art 結(jié)果。

一些可視化效果圖如下。

在 上對比一些經(jīng)典方法(EAST、RRPN、++)的 FP 情況,可以看到我們的方法可以有效抑制 FP。

-Up方法:

本文由曠視檢測組和南京大學(xué)合作,從另一種思路去解決彎曲文字檢測的問題,即像素級語義分割。考慮到基于 box的方法無法很好地建模彎曲文字,語義分割方法對文字進(jìn)行像素級分類,可以很容易建模彎曲文字,但是對于挨得很近的文本實(shí)例則無法區(qū)分,如下圖所示。

直接用語義分割來檢測文字又會遇到新問題:很難分離靠的很近的文字塊。因?yàn)檎Z義分割只關(guān)心每個(gè)像素的分類問題,所以即使文字塊的一些邊緣像素分類錯(cuò)誤對 loss 的影響也不大。

對于這個(gè)問題,一個(gè)直接的思路是:增大文字塊之間的距離,使其離得遠(yuǎn)一點(diǎn)。基于這個(gè)思路,曠視研究院引入了新的概念 “”,顧名思義就是文字塊的核心。

從下圖可知:利用“”可以有效地分離靠的很近的文字塊。

首先看一下網(wǎng)絡(luò)結(jié)構(gòu):

網(wǎng)絡(luò)采用 FPN 結(jié)構(gòu),輸入一張圖片,網(wǎng)絡(luò)會預(yù)測出帶有不同尺度的 的分割結(jié)果,并通過漸進(jìn)式擴(kuò)展算法去重建文字區(qū)域。

本文通過引入漸進(jìn)式擴(kuò)展算法(PSE),可以高效地基于多個(gè)尺度的 重建出文字區(qū)域。具體流程如下:

該算法主要是對于每個(gè) ,向其周圍上下左右四個(gè)方向擴(kuò)展像素,直到到達(dá)最大的 的分割邊界或者兩個(gè) 在擴(kuò)展時(shí)沖突。 因此該算法可以區(qū)分挨得很近的文字實(shí)例。

在兩個(gè)彎曲文字檢測數(shù)據(jù)集上都取得了 SOTA 結(jié)果,并在多方向數(shù)據(jù)集上也取得了令人滿意的結(jié)果。

一些可視化效果圖如下。

最重要的是,在壓縮 和圖片分辨率的情況下, 可以做到實(shí)時(shí)性檢測,而檢測結(jié)果同樣具有競爭力,這是第一個(gè)在彎曲文字?jǐn)?shù)據(jù)集上實(shí)現(xiàn) >20FPS 的算法。

ICDAR 2019 - Text 經(jīng)驗(yàn)分享

ICDAR “ ” 競賽是評估自然場景/網(wǎng)絡(luò)圖片/復(fù)雜視頻文本提取與智能識別新技術(shù)進(jìn)展的權(quán)威國際賽事及評測標(biāo)準(zhǔn),競賽中涌現(xiàn)出諸多方法持續(xù)推動(dòng)業(yè)界新技術(shù)的創(chuàng)新與應(yīng)用。參與者不乏國內(nèi)外頂尖 CV 公司團(tuán)隊(duì)和知名高校實(shí)驗(yàn)室團(tuán)隊(duì)。

曠視檢測組的幾名實(shí)習(xí)生參加了本次比賽,這個(gè)部分主要分享一些曠視檢測組在 ArT 比賽中獲得冠軍的一些經(jīng)驗(yàn)。

比賽獲獎(jiǎng)鏈接如下:rrc.cvc.uab.es/files/IC

首先放出比賽結(jié)果:

簡單介紹一下任意形狀文本檢測的任務(wù):傳統(tǒng)的物體檢測的方法使用的是四點(diǎn)框或者是矩形框,但是因?yàn)槲淖直旧淼男螤罹哂卸嘧冃裕罄m(xù)的一些彎曲文字的數(shù)據(jù)集比如 Total Text 和 CTW 都是采用多個(gè)點(diǎn)的標(biāo)注形式cnn自然場景文本檢測,而這次 ArT 比賽使用的數(shù)據(jù)是目前為止最大的彎曲文字?jǐn)?shù)據(jù)集,一共有 10166 張圖像(5603 張訓(xùn)練圖像和 4563 張測試圖像)。

本文方法是 base 在 Mask R-CNN 之上,網(wǎng)絡(luò)整體流程如下:

對于多點(diǎn)的標(biāo)注,先求其最小外接的矩形作為 Mask R-CNN 的 gt box,而多點(diǎn)的標(biāo)注就作為 gt mask,一個(gè)簡單的可視化效果如下圖所示:

上圖中,黃色框是訓(xùn)練數(shù)據(jù)的 gt 的標(biāo)注,而綠色的矩形是我們根據(jù) gt 生成的 box。

當(dāng)然cnn自然場景文本檢測,只有 Mask R-CNN 是不夠的,實(shí)際中我們會遇到各種問題,比如說文字有一個(gè)很神奇的特性:文字框的某些部分還是文字,但是物體檢測中的物體是沒有這種局部性的。所以有時(shí)候會出現(xiàn)斷框的情況,拿上圖舉例,可能你檢測模型的結(jié)果是“天主”出了一個(gè)框,“堂”出了一個(gè)框,這樣在評價(jià)指標(biāo)下肯定是不如“天主堂”出一個(gè)框更好的。

雖然對于這類問題我們可以采取后處理方法去解決,但是后處理方法要么邏輯復(fù)雜很難寫,要么效果不理想,解決的方法不是很本質(zhì),因此最好的方法是在網(wǎng)絡(luò)層面解決這個(gè)問題。

再比如一些圖像因?yàn)榕臄z視角的原因可能會導(dǎo)致文字本身的檢測變得非常困難,嘗試采取 變換也不能很好地解決等等問題。

那么怎樣解決上述的一些問題呢?

在這次比賽中,對于第二個(gè)問題我們借鑒了 SeNet 中 的做法,這樣使得我們的模型能更好地 focus 在需要關(guān)注的特征上,這種做法可以有效檢測出一些因?yàn)橐暯菃栴}導(dǎo)致的 bad case。

一個(gè)簡單的例子如下圖所示(綠色部分是我們模型檢測結(jié)果,紅色是 gt box 結(jié)果,圖像來自我們自己切出來的 set,下同):

另外對于預(yù)測的 box 的情形,我們采用了增大模型感受野的方法,除了加深網(wǎng)絡(luò)本身的層數(shù)之外,我們還在檢測模型的中加入了 PSP 模塊,這樣做可以使得我們可以 cover 住一些極致長寬比的文字,可以有效殺掉模型中的 FP,使得模型在高 IoU 的結(jié)果下面更好。

效果如下圖所示:

上圖中的“愛酷兒”和“品牌折扣店”很容易檢測成兩個(gè) box,但是采用我們的方法增大了模型的感受野之后就可以更好地解決這個(gè)問題,相比一些繁瑣的后處理的方法也更加有效。

可以看到,我們在 IoU>0.5 和 IoU>0.7 兩個(gè)指標(biāo)下的分值上都是第一,而且在高 IoU 下的優(yōu)勢更加明顯,這表明相比其他隊(duì)伍的參賽模型,我們的模型預(yù)測的 box 也更加精準(zhǔn)。

我們在最后的 中融合了 v2 作為 的模型, v2 也是曠視的工作。

當(dāng)然,實(shí)際比賽中的問題遠(yuǎn)不止這些,篇幅原因我們拿上述兩個(gè)問題簡單分析一下。

感謝隊(duì)友@王楓(計(jì)算所) @胡立(浙大)@孫培澤(西交) @王文海(南大) 在比賽中做出的貢獻(xiàn),這是我們幾個(gè)在曠視組實(shí)習(xí)期間一起做的工作。

作者簡介

謝恩澤,同濟(jì)大學(xué)計(jì)算機(jī)碩士,曠視研究院 Team算法研究員,研究方向文字檢測、識別等;文字檢測算法 和 作者;2019 年參加文字領(lǐng)域權(quán)威比賽 挑戰(zhàn)賽 - Text 獲得冠軍。

參考文獻(xiàn)

[1]Tian, Z.; Huang, W.; He, T.; He, P.; and Qiao, Y. 2016. text in image with text . In ECCV.

[2]Zhou, X.; Yao, C.; Wen, H.; Wang, Y.; Zhou, S.; He, W.; and Liang, J. 2017. East: an and scene text . In CVPR.

[3]Liao, M.; Shi, B.; Bai, X.; Wang, X.; and Liu, W. 2017. : A fast text with a deep . In AAAI.

[4]Liao, M.; Shi, B.; and Bai, X. 2018. ++: A - shot scene text . IEEE on Im- age .

[5]Shi, B.; Bai, X.; and , S. 2017. text in by . CVPR.

[6]Ma, J.; Shao, W.; Ye, H.; Wang, L.; Wang, H.; Zheng, Y.; and Xue, X. 2018. - scene text via . IEEE on .

[7]E.Xie,Y.Zang,S.Shao,G.Yu,C.Yao,andG.Li. with . arXiv arXiv:1811.08605, 2018.

[8]Wang W, Xie E, Li X, et al. Shape Text with Scale [J]. arXiv arXiv:1903.12473, 2019.

[9]C. K. Ch’ng and C. S. Chan. Total-text: A for scene text and . In ICDAR, 2017.

[10]Y. Liu, L. Jin, S. Zhang, and S. Zhang. curve text 930 in the wild: New and new . 2017.

[11] Liu, Xuebo Liu, Jie Sheng, Ding Liang, Xin Li, Liu. Mask Text [J] arXiv arxiv:1903.11800

[12]Long S, Ruan J, Zhang W, et al. : A for text of [C]// of the on (ECCV). 2018: 20-36.